赌钱赚钱app而这亦然PI一直执意的意见之一-真实赌钱app下载

新闻资讯

赌钱赚钱app而这亦然PI一直执意的意见之一-真实赌钱app下载

发布日期:2026-04-23 07:08 点击次数:152

今天凌晨,Physical Intelligence发布了全新的VLA模子π0.7,狠狠敲了全国模子一记闷棍。

π0.7第一次在机器东谈主限度解释了Compositional Generalization(组合泛化),且VLA。

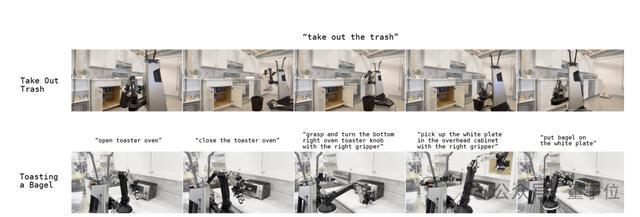

在碰到新任务时,模子不错组合以前学过的原子手段,我方拼出解法。

就像乔丹会跳投、会后仰,碰到新防备时我方琢磨出后仰跳投。

没东谈主专门教他这一招,他我方组出来了。

Demo里最炸的两个:

任务泛化:机器东谈主没见过空气炸锅,也能笔据提示,组合机械臂作为把红薯烤出来。

骨子泛化:把从一个机械臂学来的合手取政策,平直部署在另一台机械臂上。

更离谱的是,Physical Intelligence的询查员我方也说不清π0.7到底会什么。

他们还在探索领域,玩起来很道理,到咫尺为止末打量配令东谈主惊喜。

切黄瓜、削皮、倒垃圾、烤红薯……齐颖悟

用Physical Intelligence的询查员Ashwin Balakrishna说:

我畴昔总能笔据西席数据猜出模子能作念什么。这一次,我猜不到了。

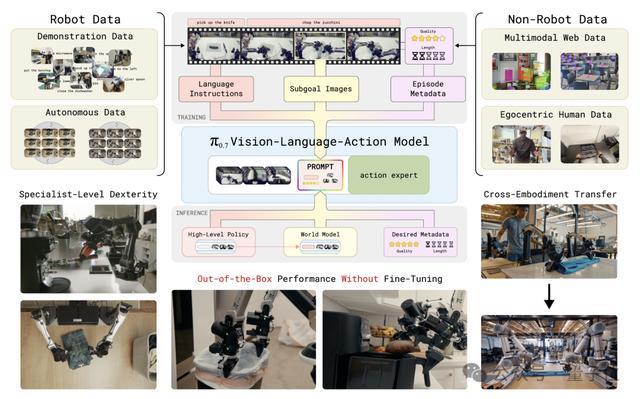

π0.7:具有知道智商的可控模子

π0.7最中枢的洞见唯有一句话,各样化的数据需要各样化的prompt。 但它带来的末端,远比这句话自己要真切得多。

用各样化的prompt,吃下各样化的数据

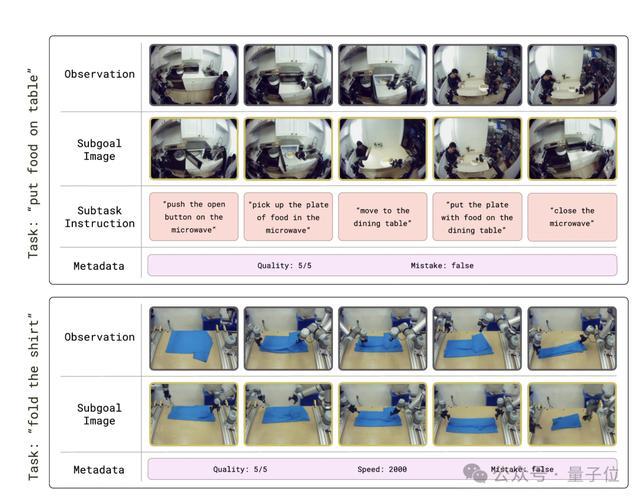

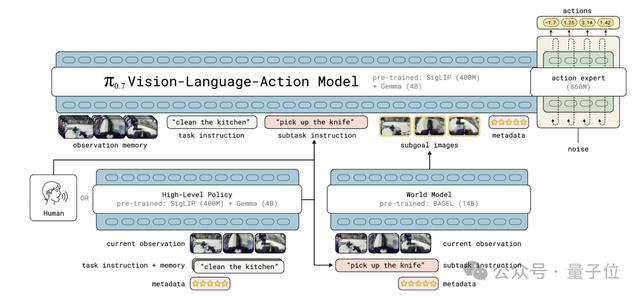

畴昔VLA西席只喂一句计帐雪柜,模子获得的信号是单一的。π0.7把prompt张开成四层:

任务提示(计帐厨房)+子任务提示(翻开雪柜)+子方针图像(下一秒画面应该长什么样)+episode元数据(这条数据质地几分、有莫得出错、速率多快)。

有了这些丰富的context,模子就能分得清西席数据里的锐利、快慢、对错。

然后它就能吃下以前吃不了的数据。失败的rollouts,低质地的演示,其他机器东谈主的片断,东谈主类的egocentric视频,十足酿成有效的信号。

换句话说,各样数据自己不是问题,问题是模子不知谈我方在学什么。

π0.7加的那层prompt,即是让模子知谈“这段数据是什么质地、用什么政策作念的”。

于是,具身限度第一次出现通才追平专才的知道手艺。

通才追平专才

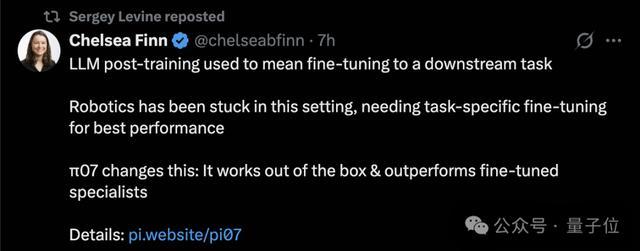

在转帖中,Physical Intelligence调解首创东谈主Chelsea Finn说了一个很故道理的对比:

大谈话模子的后西席,畴昔指的是针对卑劣任务作念微调。一直以来,机器东谈主也卡在这个阶段,念念要最佳的性能,就得针对具体任务微调。

π0.7改变了这少量:开箱即用,并且跨越了fine-tuned的大众模子。

口说无凭,实验数据是这样的:

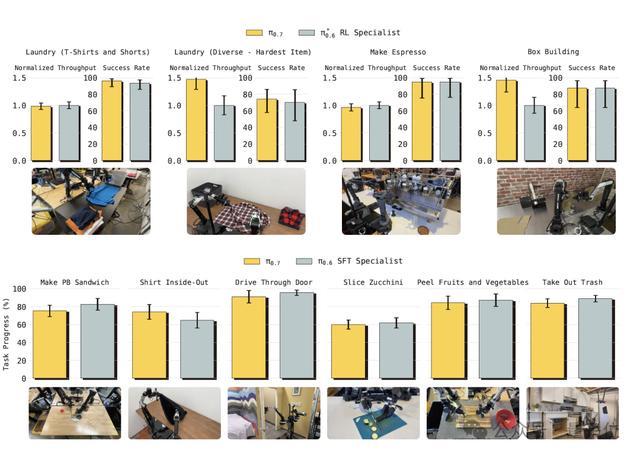

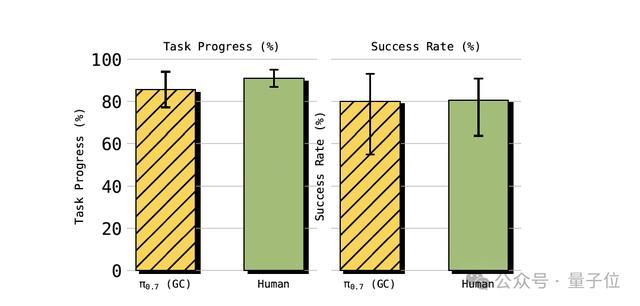

π0.7没作念任何专项西席,就能在作念咖啡、叠穿戴、装箱三个复杂任务上,追平π0.6经由微调的的大众模子。

这里说的大众模子有两种,一种是π*0.6的RL specialist,用RECAP措施针对咖啡、装箱、叠穿戴单独训过。

另一种是π0.6上的SFT specialist,针对每个任务单独微调过。

更离谱的是,在叠穿戴和装箱这两个最难的任务上,π0.7的比RL specialist单元时辰完成的次数更多。

不错说,一个什么齐没专门训过的通才,打过了专门为某个任务训出来的专才。而这亦然PI一直执意的意见之一。

组合泛化起先知道

π0.7的知道智商分红四块。

开箱即用的dexterity:作念咖啡、叠穿戴、剥蔬菜、削西葫芦、换垃圾袋。一起不作念任务专项西席。

提示泛化:在4个没见过的厨房和2个没见过的卧室里,随着3-6步通达提示干活。

致使能听懂提起阿谁最大盘子里的生果、提起我用来喝汤的阿谁东西这种复杂空间和语义指代。

跨骨子泛化:在叠T恤等任务中,西席数据里一条UR5e叠穿戴的样本齐莫得。

π0.7不但作念出来了,任务完成度85.6%,和10个平均375小时teleoperation劝诫的顶级东谈主类操作员的90.9%基本打平。

并且π0.7我方琢磨出了和source robot完全不同的合手取政策——

东谈主类操作员在源机器东谈主上用歪斜夹爪贴住桌面合手,π0.7在UR5e上用的是垂直合手取,因为这更得当UR5e更长的手臂通顺学。

组合任务泛化:

用空气炸锅作念红薯、烤贝果、按下按钮、用抹布擦耳机和尺子、拧旋钮和桌面电扇,西席数据里一条齐莫得。

这不是多作念了几个任务的增量,是机器东谈主第一次像LLM那样,从西席数据里显流露新智商。

正如,Sergey Levine说的:

一朝模子特出阿谁阈值,从「只可作念鸠合过数据的事」酿成「起先重组出新事」,智商就会超线性地随数据增长。

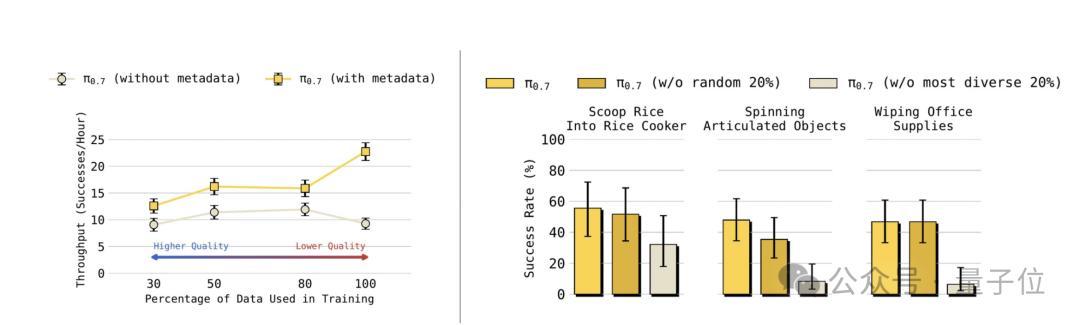

数据过滤可能是个伪问题

论文里藏着一个相配反直观的实验。

询查把叠穿戴的数据按质地分四档:top30%、top50%、top80%、一起数据。

然后区别训两个版块的π0.7,一个加metadata(每条数据打上质地几分、有莫得出错、多快完成的标签),一个不加。

末端很故道理。

不加metadata的版块,数据越多,性能越差——因为混入了低质地数据把模子带歪了。

加了metadata的版块,数据越多,性能越好——哪怕平均质地鄙人降。

这意味着统统这个词具身限渡畴昔几年齐在作念的“数据清洗”,可能是个伪问题。

只消模子知谈每条数据的质地标签,它就能我方决定要学什么、不学什么。

垃圾数据不再是垃圾,是带着quality=1/5标签的有效信号。失败数据也不是要丢掉的东西,是告诉模子这样干会失败的反面讲义。

畴昔统统东谈主齐在注意翼翼地挑演示、删失败、洗数据。π0.7说,别洗了,告诉模子哪些脏就行。

π0.7是怎么作念到的?

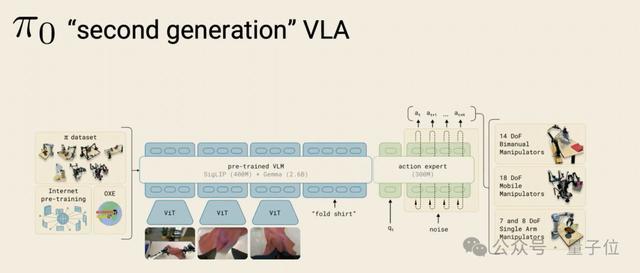

π0.7是一个5B参数的模子,分三块。

VLM主干:4B参数的Gemma3,认真结实视觉停战话。

Action expert:860M参数的transformer,用flow matching生成调解作为chunk,50Hz高频末端。

World model:从14B的BAGEL图像生成模子运改变,认真给π0.7画出异日几秒应该是什么样子。

在推理中,模子输入包括:4路录像头(前视+两个腕部+可选后视)、每路6帧历史画面、机器东谈主重要景色、再加上任务提示、子任务提示、元数据、以及world model及时画出的次方针图像。

输出是一段50步的action chunk,推行实施15到25步,然后再推下一段。

说到这里,可能有东谈主会问,π0.7里塞了个world model,这算不算和全国模子派会通了?

半算,半不算。

全国模子派的中枢是让模子学会模拟物理演化:给一个作为,琢磨全国酿成什么样。policy基于这个琢磨作念方案。

π0.7里的world model不干这事。它只认真一件事,把任务提示翻译成奏效那一帧应该长啥样。不琢磨作为后果,不模拟物理,不参与方案链路。

它是个消歧器,不是个筹办器。

用全国模子派的火器,干了一件不是全国模子派念念象的事。

此外,π0.7还站在两篇前作的肩膀上,采纳了π0.6的架构基础底细,以及MEM的多模范牵记编码器(短期视频memory+永恒语义memory)。

西席上用了Knowledge Insulation——

VLM主干用FAST token作念next-token prediction西席,action expert的梯度不回传到VLM。这样VLM从互联网学来的语义常识被保护住,不被机器东谈主作为数据混浊。

但架构不是π0.7最垂危的东西,论文中也说:

咱们的孝顺不是提议新的架构或模子假想,而是一套让VLA能使用更各样化数据源的措施论。

VLM不错平直末端机器东谈主,不需要先学会念念象全国

在π0.7之前,具身圈最火的如故英伟达前年用Cosmos带起来的全国模子风潮。

让机器东谈主先学会念念象异日,再去操作咫尺。

这个门道看起来很适合直观,东谈主类不即是这样干的吗?闭上眼睛念念一下要作念什么,然后再入手。

从2025年到咫尺,这条门道收了最多的介怀力和参预。

今天,风向又要变了——VLA回来了!

而说到VLA,根柢没东谈主比Physical Intelligence更懂。

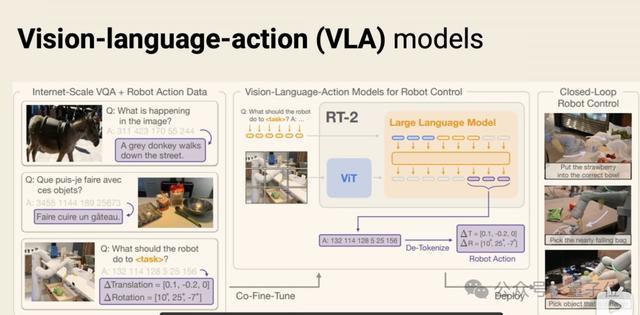

2023年,PI联创Karol Hausman、Sergey Levine、Chelsea Finn三个东谈主,在Google作念RT-2的时候,就押注了一个判断。

VLM不错平直末端机器东谈主,不需要先学会念念象全国。

道理是,你无谓让模子先学会琢磨下一帧画面、无谓让它脑补物理法令、无谓让它修复一个里面的全国模拟器。

你平直拿一个一经见过互联网的VLM,接一个作为头,端到端训,就够了。

从RT-2到π0.7,其实唯有两代VLA架构。

第一代是RT-2,把机器东谈主作为闹翻化成token,塞进VLM的next-token prediction里。

能动,但末端精度不高,并且自追忆琢磨生成慢,跟不上50Hz的高频调解末端。

第二代是π0开的头,给VLM接一个专门的action expert,用flow matching平直生成调解作为chunk。

中间那些模子——π0.5的open-world generalization、π0.6的RL自我训导、MEM的多模范牵记——

齐没改这个基座。齐是在VLM+action expert+flow matching这个结构上往上加智商。

π0.7亦然。架构上它和π*0.6莫得本质远隔,它加的是prompt的各样性。

这即是为什么论文里说”咱们的孝顺不是架构”。

但,更故道理的是另一个东谈主。

Lucy Shi,斯坦福博士生在读,师从Chelsea Finn,π0.7的中枢作家之一。

她在推特上发了一条thread,讲了一个相配真诚的故事。

之前,她随着朱玉可、Jim Fan在英伟达作念全国模子。

她押的注和Karol他们相背——

全国模子会是关键的钥匙,会在职务泛化上显贵跨越模范VLA措施。

一起先,末端确乎复古这个假定。她拿到了惊艳的组合泛化,机器东谈主能遵命没见过的提示,作念西席数据里莫得的任务,从其他机器东谈主和东谈主类视频挪动。

但有个奇怪的事情发生了。

他们拿来对比的VLA基线,一直在变强。

随着数据越收越多,VLA越来越强,直到有一天,VLA基线也起先展示出组合泛化的信号。

并且,VLA的措施苟简得多。

濒临这一问题,Lucy感到无可怎么:

当你的基线吃掉了你的询查假定,你能怎么办?你写一篇论文,去搞了了基线为什么这样强。

那篇论文赌钱赚钱app,即是π0.7。